Nos últimos quatro décadas, Henry e Margaret Tanner têm se dedicado à fabricação artesanal de sapatos de couro em sua pequena oficina em Boca Raton, Flórida. Em um anúncio no YouTube para sua empresa Tanner Shoes, Henry destaca o compromisso de não utilizar atalhos nem materiais de baixa qualidade, priorizando a honestidade e a excelência no artesanato.

O que é ainda mais surpreendente?

O Henry conseguiu realizar todas essas tarefas mesmo com a mão torcida, enquanto a pobre Margaret só possui três dedos, como pode ser observado nesta imagem do casal em seu site.

Descobri a Tanner Shoes por meio de uma série de anúncios em vídeo no YouTube. Como escritor de moda masculina há muitos anos, fiquei interessado nesses sapatos feitos de couro sintético. Em um anúncio típico da Tanner Shoes no YouTube, um vídeo apresenta um homem mais velho, possivelmente Henry, falando sobre os sapatos de couro “feitos à mão”, dizendo: “Eles não os fazem como costumavam, mas por 40 anos nós os fizemos… Os clientes afirmam que nossos sapatos têm um estilo atemporal e que valem cada centavo. Agora, você não precisará gastar muito, pois estamos nos aposentando. Pela primeira e última vez, cada par restante tem 80% de desconto.”

Tenho dúvidas sobre a autenticidade da promoção de encerramento da Tanner Shoes, pois não consegui encontrar informações online sobre Henry e Margaret Tanner, nem qualquer prova da existência do negócio Tanner Shoes em Boca Raton. Entrei em contato com a Tanner Shoes para verificar a existência dos proprietários, a localização da empresa e se realmente encerrará em breve, mas não obtive resposta.

Os membros do Reddit não ficaram surpresos ao notarem anúncios de vídeo muito semelhantes aos do YouTube promovendo outras lojas falsas. Isso demonstra que essas práticas enganosas não são incidentes isolados. De acordo com um usuário do Reddit, já foram vistos anúncios similares em outros idiomas, nos quais uma avó virtual estaria fechando sua joalheria e vendendo produtos “hand-made” com desconto. Após questionamentos sobre os anúncios da Tanner Shoes, o YouTube tomou medidas e suspendeu a conta do anunciante por violar suas políticas.

chsyys/FreeImages

Esses anúncios representam uma tendência em ascensão de anúncios em vídeo do YouTube que apresentam conteúdo criado por inteligência artificial. Embora anúncios de vídeo AI também estejam presentes no Instagram e TikTok, minha análise se concentrou no YouTube, a plataforma de vídeo original e mais estabelecida, pertencente à Google.

Embora a inteligência artificial tenha aplicações legítimas na publicidade, muitos dos anúncios em vídeo que utilizam essa tecnologia no YouTube são enganosos, com o intuito de persuadir o espectador a adquirir sapatos de couro ou pílulas de dieta. Embora seja difícil obter estatísticas confiáveis sobre fraudes envolvendo AI, o FBI alertou em 2024 que crimes cibernéticos com o uso dessa tecnologia estão aumentando. De acordo com um relatório do Bolster, as fraudes online e tentativas de phishing cresceram 94% desde 2020.

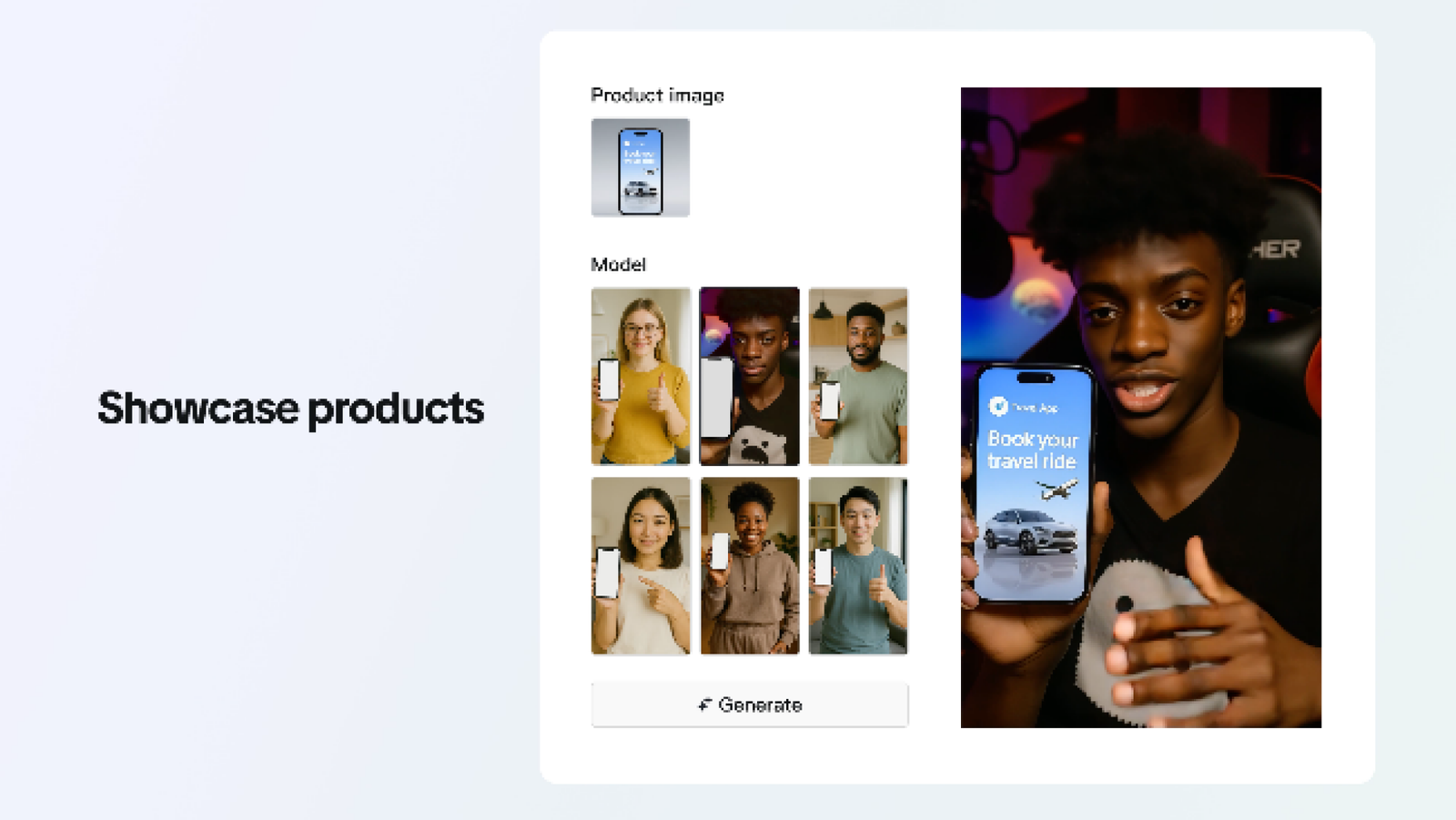

As ferramentas de inteligência artificial têm a capacidade de produzir vídeos, imagens e áudio de forma rápida. Com o auxílio dessas ferramentas, golpistas podem criar facilmente “atores” de inteligência artificial para serem usados em seus anúncios.

Em um vídeo de propaganda revisado pelo AI Mashable, foi apresentado um ator de inteligência artificial atuando como um profissional de finanças. Este anúncio foi exibido repetidamente durante várias semanas para diversos usuários no Reddit e LinkedIn.

No vídeo, um analista financeiro não identificado garante que ele é o único consultor financeiro que compartilha todas as suas negociações online e destaca que ganhou 18 das últimas 20 negociações. Ele convida os espectadores a clicarem em um link para se juntarem a um grupo secreto do WhatsApp. Outros personagens de inteligência artificial prometem auxiliar os espectadores a descobrirem um segredo incrível para perder peso (“Consegui perder 20 libras usando apenas três ingredientes que já tinha na parte de trás da geladeira!”). Alguns são simplesmente celebridades diretas.

Personalidades famosas e vídeos publicitários de inteligência artificial enganosos.

Fiquei surpreso ao ver Hoda Kotb, ex-anfitriã, divulgando dicas de emagrecimento em um vídeo no YouTube, mas lá estava ela, conversando descontraidamente com a câmera.

Mulheres, a receita popular de sal rosa foi mencionada no programa Today, mas para quem não viu, estou aqui para mostrar como fazer esse truque rápido que recebi tantos pedidos nas redes sociais. Como mãe solteira de duas meninas, tenho pouco tempo para mim mesma. Experimentei o truque do sal rosa para emagrecer mais rápido, mas tive que parar porque derretia muito rapidamente.

Este imitador de Kotb assegura que, embora a promessa deste segredo para perder peso pareça boa demais para ser verdade, é autêntico. Ele afirma que é a mesma fórmula usada por celebridades japonesas para manter a forma. Mesmo quando descobri sobre essa técnica, eu também duvidei. De acordo com Harvard e Johns Hopkins, é 12 vezes mais eficaz do que Mounj (sic)… Se você não perder pelo menos quatro pedaços de gordura, eu irei pessoalmente comprar um estojo de canetas Mounjaro.

Clique no anúncio e será redirecionado para um vídeo com mais celebridades e depoimentos de clientes fictícios. No entanto, em vez de revelar a receita de perda de peso prometida, o vídeo promove pílulas de dieta Exi Shred. Embora os representantes de Kotb não tenham respondido a um pedido de comentário, foi encontrado o vídeo original que foi utilizado para criar este deepfake. Esse vídeo original foi postado no Instagram em 28 de abril e já estava sendo usado em anúncios de vídeo AI até 17 de maio.

Kotb é mais uma pessoa afetada pelos deepfakes de IA, que são tão avançados que conseguem burlar a verificação de anúncios do YouTube.

Muitas vezes, as criações de inteligência artificial podem parecer reais à primeira vista, mas se observadas com atenção, é possível identificar pistas que revelam sua natureza artificial. Por exemplo, no caso do deepfake de Kotb, foi utilizado um vídeo real modificado, fazendo com que as expressões faciais e movimentos das mãos se repitam de forma artificial. Além disso, esses imitadores de IA podem ocasionalmente apresentar falhas, como pronunciar palavras de maneira incoerente.

O analista financeiro AI prometeu ao transmitir ao vivo negociações no Twitch, mas acabou pronunciando erroneamente “livestream” como “give-stream” em vez de “cinco-stream”. Além disso, em vídeos de IA sobre perda de peso, os atores de IA cometem erros ao pronunciar frases simples, como “Eu perdi 35 libras”, onde “lbs” é pronunciado de forma estranha como “vell-bees”. Também observei falsos Elon Musks pronunciando “DOGE” como “doggy” em golpes de criptomoedas.

Entretanto, nem sempre ocorre uma informação.

Você consegue identificar o que é verdadeiro? Está seguro disso?

Desde que comecei a examinar os anúncios de vídeo com inteligência artificial no YouTube, comecei a observar atentamente todos os protagonistas que apareciam. Muitas vezes é desafiador distinguir entre um modelo bem produzido e uma representação brilhante da IA, ou discernir a atuação fraca de um vídeo influenciador que foi digitalmente modificado.

Dessa maneira, a cada vez que um novo anúncio foi reproduzido no YouTube, eu analisei minuciosamente cada aspecto – a voz, as vestimentas, os gestos faciais, os óculos. O que era autêntico? O que era artificial?

Com certeza, eu pensei, não é o apresentador da Fox News, Dr. Drew Pinsky, que está vendendo suplementos caros falsificados, mas alguém diferente? E será que é Bryan Johnson, a estrela viral do vídeo “Eu quero viver para sempre”, que está comercializando “proteína da Longevidade” e azeite extra virgem? Parece que sim. Vale ressaltar que muitas celebridades de fato participam de propagandas comerciais e vídeos no YouTube.

Paráfrase: E sobre aquela pessoa careca e brilhante que diz ter um método secreto para reduzir o colesterol, que as indústrias farmacêuticas não querem que você saiba? E essa mulher com óculos, próxima a nós, que está vendendo um software para automatizar meus relatórios financeiros, será que é verdade? Estou confuso sobre o que é real.

Assista a muitos anúncios de vídeo no YouTube e perceberá que os modelos filtrados e influenciadores parecem cada vez mais irreais.

Para complicar ainda mais, a maioria dos comerciais em vídeo de inteligência artificial que vi no YouTube não mostrava personagens e cenários desenvolvidos do zero.

Em vez de utilizar vídeos reais das redes sociais, os anunciantes optam por modificar os movimentos labiais e áudio para que os indivíduos pareçam dizer o que desejam. Segundo Henry Ajder, especialista em deepfakes de inteligência artificial, esses vídeos gerados por IA são populares devido à sua acessibilidade e facilidade de criação com ferramentas disponíveis para sincronização labial e clonagem de voz. Esses vídeos mais refinados são extremamente difíceis de serem identificados como inteligência artificial à primeira vista.

De acordo com Hany Farid, professor da Universidade da Califórnia Berkeley e especialista em inteligência artificial, é possível criar um vídeo de uma pessoa falando ou fazendo algo a partir de apenas 20 segundos de sua voz e uma única fotografia.

Ajder mencionou que há diversas ferramentas disponíveis para produzir conteúdo de influenciadores de estilo totalmente gerado por inteligência artificial. Além disso, o TikTok revelou recentemente novos influenciadores gerados por IA que os anunciantes podem empregar na criação de anúncios em vídeo.

O YouTube deveria oferecer respostas para propagandas enganosas. As diretrizes de inteligência artificial generativa do Google e as normas do YouTube contra a distorção proíbem a utilização de IA para disseminação de informações incorretas, distorcidas ou atividades fraudulentas, incluindo fraudes, golpes e outras práticas enganosas. As políticas também impedem o uso indevido da identidade de uma pessoa (viva ou falecida) sem uma divulgação explícita com o intuito de enganar.

Qual é a situação?

Os clientes merecem receber informações transparentes sobre o material produzido pela inteligência artificial.

Para os espectadores que desejam distinguir entre a realidade e a ficção, as indicações claras de conteúdo gerado por inteligência artificial em anúncios de vídeo podem ser úteis.

Enquanto navega pelo YouTube, é possível observar que alguns vídeos apresentam uma etiqueta indicando que o conteúdo foi editado ou gerado digitalmente, seja no áudio ou nas imagens. Em vez de exibir essa informação de forma destacada no vídeo, o YouTube costuma incluir esse aviso na descrição do vídeo.

Você pode pensar que um anúncio em vídeo no YouTube criado pela inteligência artificial teria que incluir essa divulgação, porém, de acordo com o YouTube, isso não é necessário.

O emprego de conteúdo produzido por inteligência artificial não infringe as diretrizes de publicidade do YouTube, sendo até mesmo encorajado, e em geral não requer divulgação. A exceção ocorre nos casos de anúncios que utilizam conteúdo gerado por IA em vídeos ligados a eleições ou assuntos políticos, nos quais a divulgação é exigida pela plataforma.

Em resposta às perguntas da Mashable sobre os anúncios em vídeo com inteligência artificial, Michael Aciman, gerente de comunicação de políticas do Google, afirmou que possuem diretrizes claras e exigências de transparência para a utilização de conteúdo gerado por IA em anúncios. Isso inclui a obrigatoriedade de divulgação para anúncios eleitorais e a presença de marcas d’água de IA em conteúdos de anúncios criados com as ferramentas de IA da empresa. Além disso, eles reforçam vigorosamente suas políticas para proteger as pessoas contra anúncios prejudiciais, como golpes, independentemente da forma como o anúncio é produzido.

O grande número de vídeos e anúncios enviados diariamente para o YouTube faz com que os anúncios em vídeo AI que quebram as regras da plataforma passem despercebidos. Em 2024, o Google suspendeu mais de 700.000 contas de anunciantes fraudulentos, não apenas vídeos fraudulentos, demonstrando a escala do problema. No mesmo ano, o Google interrompeu 5,1 bilhões de “anúncios ruins” e quase 147 milhões de anúncios que violavam as políticas de deturpação, de acordo com seu Relatório de Segurança de Anúncios.

O YouTube está adotando mais inteligência artificial para lidar com o conteúdo enganoso, complementando a revisão humana. Investindo em sistemas automatizados com tecnologia LLM, o YouTube busca combater os golpes de personificação da figura pública. Uma equipe de mais de 100 especialistas foi reunida para desenvolver contramedidas eficazes, como atualizar a política de misrepresentação para suspender anunciantes envolvidos nesses golpes.

Após questionar a empresa sobre vídeos de inteligência artificial mencionados nesta publicação, o YouTube tomou a decisão de suspender no mínimo duas contas de anunciantes; os utilizadores também têm a possibilidade de denunciar anúncios enganosos para serem analisados.

- O YouTube exibirá anúncios nos momentos mais populares dos vídeos.

- Testes do Google com apresentadores de podcasts criados por inteligência artificial em resultados de busca.

- O Gerador de vídeo AI Veo 3 da Google é único e inovador, surpreendendo a todos pela sua originalidade. O mundo ainda não está preparado para ele.

Entretanto, embora as celebridades claramente violem as políticas de publicidade do YouTube (e a legislação federal), as normas que regulam os atores e os anúncios gerados pela IA de forma geral são menos definidas.

O vídeo da AI permanecerá disponível.

Caso o YouTube seja preenchido com vídeos feitos por inteligência artificial, você não precisará procurar longe por uma explicação. A novidade vem de dentro da própria empresa. Durante o Google I/O 2025, o Google apresentou o Veo 3, um novo e inovador modelo para gerar vídeos e diálogos com IA. O Veo 3 representa um avanço significativo na criação de vídeos com inteligência artificial, conforme já foi mencionado anteriormente no Mashable.

Em resumo, o lançamento recente do Veo 3 o exclui como responsável pelos vídeos enganosos mencionados no texto. Além disso, o Google implementou uma marca d’água oculta em todos os vídeos Veo 3 como medida de identificação (recentemente também foi introduzida uma marca d’água visual). Mesmo assim, com a popularização das ferramentas de Inteligência Artificial disponíveis ao público, é provável que o número de vídeos falsos na internet aumente.

Um dos primeiros conteúdos populares do Veo 3 que assisti foi um comercial de medicamentos. Embora o comercial tenha sido feito para ser engraçado, não me causou risos. Qual é a repercussão quando uma empresa farmacêutica utiliza um ator de inteligência artificial para representar um farmacêutico ou médico?

O especialista em Deepfake Henry Ajder afirma que a presença de inteligência artificial em anúncios está nos obrigando a lidar com a desonestidade que já existe na publicidade.

Uma das principais questões é que ele é mantido em segredo da sociedade, como se a salsicha já estivesse sendo feita, o que gera desconfiança e a sensação de ser enganado. Mas, eventualmente, descobre-se que a pessoa envolvida é apenas alguém contratado aleatoriamente de uma agência.

Nos Estados Unidos, os anúncios de televisão e outros comerciais devem obedecer às leis de proteção ao consumidor e estão sujeitos à regulamentação da Comissão Federal do Comércio. Em 2024, a FTC aprovou uma regra que proíbe a utilização de inteligência artificial para personificar agências governamentais e empresas, e o Congresso recentemente aprovou uma lei chamada “Take It Down” que criminaliza as deepfakes. No entanto, muitos vídeos gerados por IA estão em uma zona legal cinzenta, sem regras explícitas.

É um questionamento complexo: Se um anúncio completo é produzido com atores de inteligência artificial, sem uma divulgação clara, esse comercial é considerado enganoso? E seria mais enganoso do que empregar atores para interpretar personagens de farmacêuticos fictícios, pagar influenciadores para promover produtos, ou utilizar o Photoshop para alterar a aparência de um modelo?

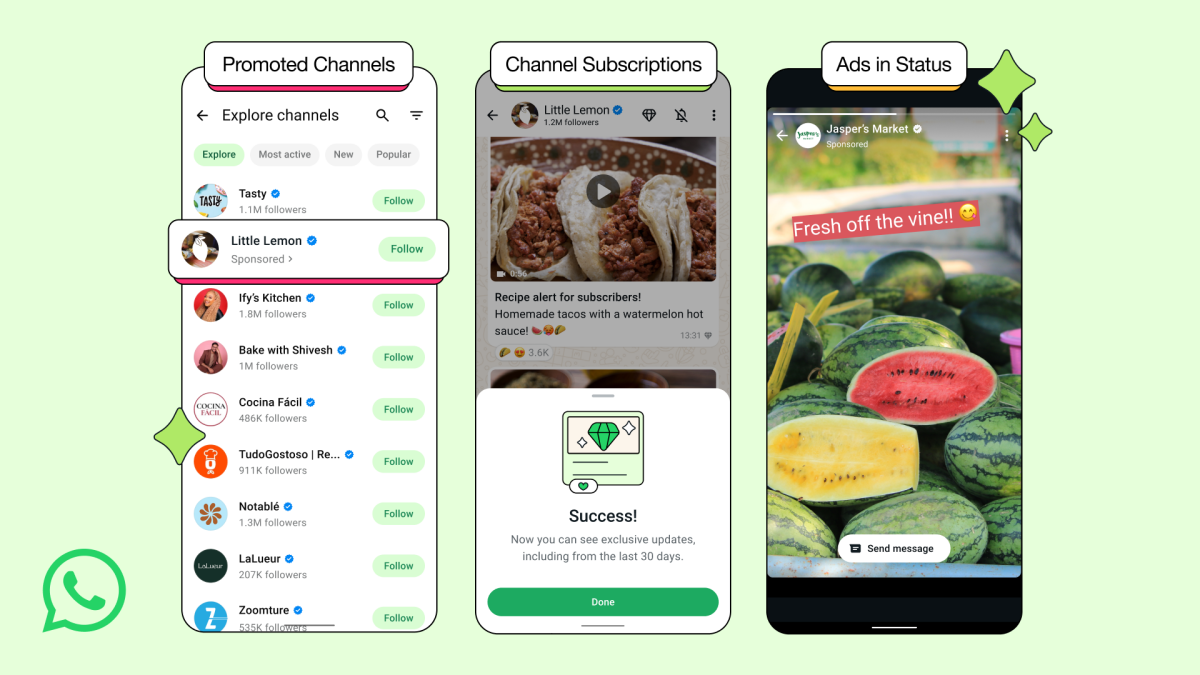

O YouTube está utilizando a tecnologia Google AI para criar materiais de publicidade, como anúncios em vídeo, visando economizar tempo e recursos. O Google destaca em seu blog como suas soluções de publicidade com AI podem auxiliar na criação e adaptação de vídeos para diversos formatos de anúncios do YouTube. Com o sucesso do Google Veo 3, é provável que em breve plataformas como o YouTube permitam que anunciantes gerem anúncios completos por meio da inteligência artificial. Recentemente, o TikTok também anunciou essa funcionalidade.

A FTC afirma que a decisão sobre se uma empresa precisa ou não informar que está empregando “atores de IA” varia de acordo com a situação, sendo que muitas normas da FTC são imparciais em relação à tecnologia utilizada.

De acordo com um representante da FTC do Bureau de Proteção ao Consumidor, da mesma forma que os anunciantes precisam fazer divulgações sobre os atores humanos, como informar que são apenas atores e não profissionais de saúde, essas mesmas divulgações seriam necessárias para uma persona criada por IA em uma situação similar. Isso foi comunicado por e-mail ao Mashable.

A mesma situação se aplica quando uma inteligência artificial cria um “testemunho” em um anúncio. Se a IA está gerando um depoimento falso ou afirmando ter certas qualificações que influenciam a credibilidade do falante, isso pode ser enganoso para os consumidores, de acordo com o representante mencionado.

O FTC Ato, uma legislação ampla que trata de assuntos como feedback de consumidores, impede a fabricação de depoimentos enganosos. Em outubro de 2024, a regulamentação FTC intitulada “Regra sobre o Uso de Avaliações e Testemunhos de Consumidores” proibiu expressamente depoimentos falsos de celebridades.

Entretanto, alguns especialistas em fraudes de alta tecnologia e inteligência artificial consideram que é necessária uma nova legislação com urgência para garantir a proteção dos consumidores.

O professor Farid afirmou que as leis atuais nos Estados Unidos em relação ao uso da imagem de outra pessoa estão antiquadas e não foram desenvolvidas considerando a era da inteligência artificial generativa.

Novamente, a quantidade total de vídeos gerados por inteligência artificial e a simplicidade de produzi-los dificultarão a aplicação das regras já existentes.

Farid expressou o desejo de que as plataformas como YouTube, TikTok, e Facebook reforcem suas medidas para combater vídeos enganosos e fraudulentos, além de destacar a importância da regulação federal nesse aspecto.

Sem normas definidas e obrigatórias para o conteúdo de Inteligência Artificial, é possível que em breve a presença de anúncios em vídeo enganosos feitos por IA se torne comum.

– Estratégias de marketing e publicidade online

Comments